近日,一場以“藝術之源賦能人文閔行”為主題的文化藝術盛事——“亮吧雅集”在閔行區浦錦街道成功舉辦。本次活動匯聚了眾多藝術家、文化學者和策劃人,旨在通過藝術交流與策劃實踐,進一步推動閔行區人文氛圍的提升。

活動伊始,與會嘉賓圍繞藝術與人文的融合展開深入探討。藝術家們分享了創作靈感與藝術對社會的影響力,強調藝術不僅是美的表達,更是文化傳承與創新的重要載體。現場還展出了包括繪畫、書法、雕塑在內的多種藝術形式,吸引了眾多觀眾駐足欣賞。

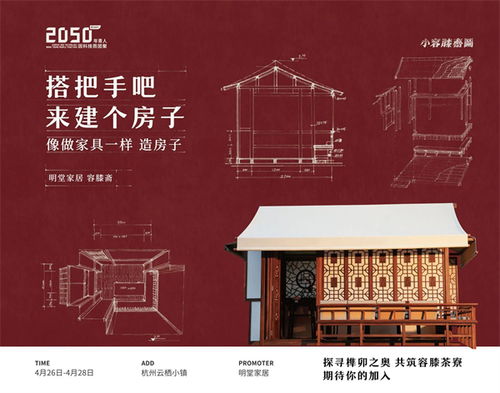

策劃環節成為本次活動的亮點之一。參與者就如何通過策劃活動促進文化藝術傳播進行了熱烈討論,提出了多項創意方案,如社區藝術節、跨界合作項目等,以期將藝術融入日常生活,賦能閔行的人文建設。

本次“亮吧雅集”不僅為閔行區注入了新的文化活力,也為藝術與人文的深度融合提供了實踐平臺。未來,類似活動有望持續舉辦,助力閔行打造更具魅力的文化高地。